Production-ready AI agents bouwen in 2026: architectuur, security en observability (met EU AI Act in het achterhoofd)

De hype rond “AI agents” is in 2026 voorbij het punt van prototype-optimisme. In vrijwel elke organisatie draait inmiddels wel iets dat kan plannen, tools kan aanroepen en taken kan afmaken zonder dat er na elke stap iemand op “OK” klikt. En precies dáár ontstaat een nieuw, ongemakkelijk inzicht: het is niet zo moeilijk om een agent iets te laten doen, maar wél om een agent betrouwbaar te laten opereren in productie—met logs die de audit overleven, met grenzen die niet via een prompt te omzeilen zijn, en met een blast radius die je CFO en CISO acceptabel vinden.

De shift van statische taalmodellen naar agentic systemen introduceert iteratieve loops (reason → act → observe → refine), tool-chaining, en non-deterministisch gedrag. Dat is architectonisch interessant, maar ook security-technisch explosief: de aanvalsvector is niet alleen “kwetsbare code”, maar ook “kwetsbaar gedrag”. De realiteit van 2026 is dat aanvallers niet altijd je backend hoeven te breken; soms is het genoeg om je agent te overtuigen dat een gevaarlijke actie “logisch” is.

Tegelijk is de lat hoger komen te liggen door governance. In Europa wordt dat heel concreet: voor high-risk use cases wordt de EU AI Act vanaf 2 augustus 2026 volledig enforceable, met boetes die kunnen oplopen tot 7% van de wereldwijde omzet. In zo’n context is “we hebben een chatbot met een paar tools” geen productstrategie meer, maar een compliance-risico als je het verkeerd inkadert.

In deze deep-dive bouw je niet één demo-agent, maar een blueprint voor een productieklare agentic stack: welke architectuurpatronen je kiest, hoe je sandboxing en secret injection hard maakt, hoe observability verandert in een control plane, en hoe je autonomie gradueel opschaalt met een volwassenheidsmodel.

Executive summary

- Kies je agent-pattern bewust: ReAct voor iteratieve acties met duidelijke stop-momenten, Planning voor dure multi-step trajecten, Multi-agent voor specialisatie (vaak 20–40% kwaliteitswinst), Sequential workflows voor voorspelbaarheid en 30–50% lagere latency.

- Behandel tool-execution als een security-domein: onbetrouwbare inputs + dynamische code + runtime evaluatie = nieuwe RCE-klassen.

- Neem het n8n-incident als les, niet als roddel: CVE-2026-25049 (9.4) laat zien hoe “veilig genoeg” expression evaluation kan eindigen in remote code execution.

- Draai ontrusted AI-code niet in Docker “zoals altijd”: voor echte untrusted code is MicroVM-isolatie (Firecracker/Kata) de betere standaard om kernel-escape risico’s te verkleinen.

- Maak van observability een control plane: distributed tracing op elke LLM-call en tool-call, plus evaluaties op sessie- én node-niveau.

- Organiseer autonomie met een maturity ladder zoals de Agentic Trust Framework (ATF): Intern → Junior → Senior → Principal, met expliciete promotiecriteria.

- EU/NL implicatie: richt je logging, human oversight, incident response en vendor due diligence zó in dat je high-risk trajecten kunt aantonen en auditen (minimaal 6 maanden logretentie voor high-risk deployers).

1) Pattern-keuze is je eerste guardrail (niet je laatste)

De meeste teams beginnen bij tools en modellen: “welke LLM gebruiken we, welke vector database, welke agent framework?” Maar in productie is de volgorde vaak omgekeerd. Je begint met het gedrag dat je wilt toestaan, en kiest dáár een patroon bij.

ReAct: de natuurlijke plek voor interlocks

ReAct (Reasoning + Acting) is populair omdat het agentic gedrag expliciet knipt in denken en doen. En juist die knip is de plek waar je in productie je controls ophangt: policy checks, tool-allowlists, risk scoring, human approval, en rate limits.

In een ReAct-loop wil je dat elke “act”-stap een contract heeft: welke tool, welke parameters, welke data scopes, en met welke side effects. Niet omdat het elegant is, maar omdat het te auditen is.

Planning: duur, maar voorspelbaar

Planning agents betalen upfront overhead om daarna goedkoper te opereren: eerst decompositie, dan uitvoering. Dat maakt ze geschikt voor trajecten waar terugspoelen duur is: security investigations, compliance checks, multi-system workflows.

Planning geeft bovendien een governance-voordeel: je kunt het plan vooraf laten beoordelen (automatisch of door een mens), in plaats van achteraf reconstrueren waarom de agent stap 7 ineens een admin-call deed.

Multi-agent: specialisatie als kwaliteits- en auditstrategie

Multi-agent systemen brengen domeinscheiding terug. Specialist agents zijn makkelijker te evalueren, te beperken en te verantwoorden. In de praktijk wordt vaak 20–40% betere outputkwaliteit gerapporteerd t.o.v. één generalist agent.

Belangrijk: multi-agent is geen vrijbrief voor chaos. Je hebt een coordinator nodig die niet alleen routeert, maar ook de security-context doorgeeft: scopes, risico, en wat wel/niet mag.

Sequential workflows: ouderwets, maar soms de beste keuze

In sommige processen wil je juist geen “slimme” routering, maar determinisme. Sequential workflows (Agent A → Agent B → Agent C) zijn vaak 30–50% sneller dan dynamische routing, juist omdat orchestration overhead ontbreekt. Debugging is simpeler, kosten voorspelbaar, en governance makkelijker.

2) Security: van “prompt injection” naar “tool-chain compromise”

Agentic security verschuift de kernvraag: niet “is mijn API veilig?”, maar “wat kan mijn agent overhalen om te doen?” Een agent die tools heeft, heeft een aanvalsvlak dat lijkt op een junior engineer met toegang tot productie—behalve dan zonder intuïtieve angst voor ‘dat voelt fout’.

De les uit n8n: runtime is waar je verliest

De n8n-kwetsbaarheden van februari 2026 zijn illustratief omdat ze niet voelen als klassieke webbugs. CVE-2026-25049 (severity 9.4) maakt remote code execution mogelijk via onveilige expression evaluation op runtime.

De kernles is groter dan n8n: compile-time garanties (zoals TypeScript types) zijn niet gelijk aan runtime waarheid. Zodra untrusted input door je systeem loopt—via webhooks, prompts, of tool outputs—moet je aannemen dat types, bounds en invariants kapot zijn. In agentic systemen gebeurt dat continu.

Sandboxing: niet “nice to have”, maar je crashbarrier

Als je agent code kan genereren of shell-achtige tools kan gebruiken, is sandboxing je primaire impactbeperker.

- Docker-containers zijn snel en handig, maar delen de kernel.

- Voor echt ontrusted AI-gegenereerde code is MicroVM-isolatie (Firecracker/Kata Containers) beter verdedigbaar: een aparte kernel verkleint het kernel-escape risicoprofiel.

De regel die in 2026 steeds vaker hard wordt: untrusted code draait nooit op hetzelfde trust-domein als secrets en productie-data.

Secret injection: MFA voor machines

Na sandboxing is secret exposure je volgende rampmodus. Naïef “alle secrets in env” is in agentic workflows niet alleen slordig, maar structureel gevaarlijk.

De betere richting is workload identity + context-based injection: de agent krijgt alleen de credentials die nodig zijn voor díe actie, in díe context, op díe plek. Denk aan policy checks op identiteit, locatie/infra en posture. Het resultaat is dat prompt-manipulatie minder impact heeft: zelfs als een agent iets “wil”, kan hij het niet zonder de juiste, tijdelijk uitgegeven sleutel.

Defense-in-depth tegen prompt-gedreven RCE

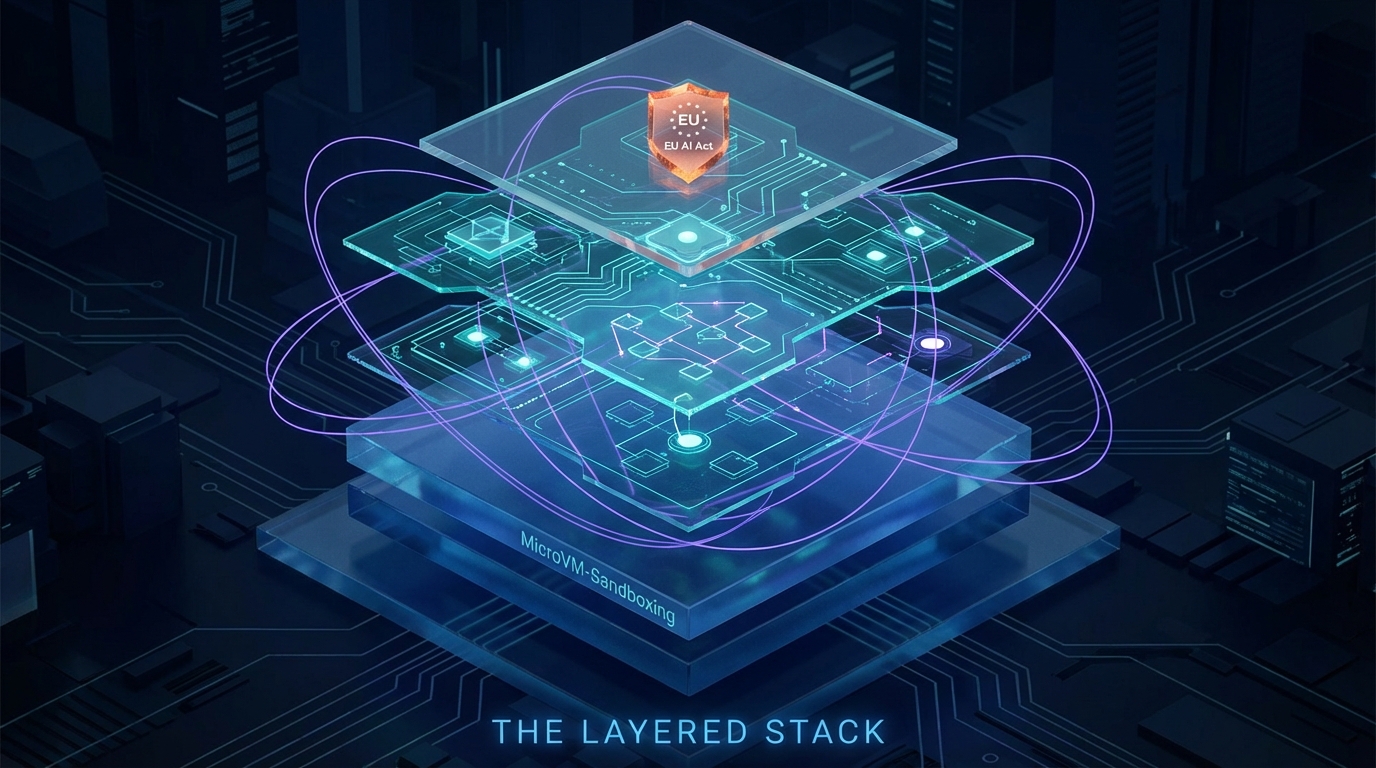

Je verdedigingslijn is gelaagd:

- Inputvalidatie en risicoscoring vóór code/tool-keuze.

- Pre-execution scanning van gegenereerde code of tool-parameters (signatures + heuristics).

- Sandboxed execution (bij voorkeur MicroVM voor untrusted code).

- Observability + anomaly detection op gedrag (tool-call spikes, rare destinations, onverwachte file access).

Belangrijk: sanitization alleen is geen “einde van het verhaal”, omdat aanvallers hun inputs iteratief kunnen aanpassen en runtime-randjes kunnen uitbuiten.

3) Observability: van dashboards naar een real-time control plane

Klassieke monitoring vertelt je dat “de service groen is”. Agentic observability moet je vertellen: welke beslissingen zijn genomen, op basis waarvan, met welke tools, en met welke risico’s.

Distributed tracing als ruggengraat

Zie een user request als een trace, met spans voor:

- LLM-generatie

- retrieval

- tool calls

- policy checks

- retries en fallbacks

Zonder spans kun je failures niet ontleden. Met spans kun je node-level problemen zien die system-level metrics maskeren: één tool faalt 2% vaker, en dat wordt 20% meer mislukte trajecten omdat het de agent in loops duwt.

Evalueer trajecten, niet alleen outputs

In productie is “het antwoord klopt” onvoldoende. Een agent kan per toeval een correct antwoord produceren via een slechte route: onnodige tool calls, verkeerde bronnen, of riskante acties.

Je evals moeten dus drie lagen hebben:

- Session-level: doel gehaald, geen onnodige loops, juiste onzekerheid.

- Node-level: tool-call correct, parameters valide, errors goed afgehandeld.

- Efficiency: latency, tokens, tool-call count.

Waarom dit governance wordt

Onderzoek in de markt laat zien dat vertrouwen de bottleneck is: organisaties die observability als control plane inrichten, komen verder dan partijen die het als rapportage zien. Je gebruikt live telemetry om guardrails te handhaven: rate limits, policy blocks, en automatische degradatie naar “Junior mode” als anomalieën oplopen.

4) Framework-keuze: waar security ‘standaard’ vaak een aanname is

Frameworks verschillen niet alleen in ergonomie, maar in attack surface.

- Workflow platforms met expression languages hebben risico’s rond runtime evaluatie; n8n toont hoe hard dit kan misgaan.

- Frameworks zoals LangGraph (graph/state in code) reduceren vaak de expressie-surface door meer in sterk getypeerde code te plaatsen, maar verschuiven verantwoordelijkheid naar jouw SDLC.

- Multi-agent frameworks zoals CrewAI geven structuur via rollen en taken, wat governance en auditing kan vereenvoudigen—mits je de coordinator hard begrenst.

De praktische vraag voor 2026 is niet: “welk framework is het best?”, maar: welk framework maakt het makkelijkst om jouw security- en audit-eisen af te dwingen?

| Keuze | Waar het in uitblinkt | Typisch risico als je niets extra’s doet |

|---|---|---|

| ReAct-loop in eigen code | Interlocks, policy checks per actie, snelle iteratie | Wildgroei aan tool wrappers zonder uniforme logging/policy |

| Planning agent | Pre-review van plan, minder backtracking | Plan wordt “schijnzekerheid” zonder runtime checks |

| Multi-agent (specialisten + coordinator) | Kwaliteit (20–40%), auditbaarheid per rol | Coordinator wordt superuser zonder duidelijke scopes |

| Sequential workflow | Voorspelbaarheid, 30–50% lagere latency | Rigide: edge cases leiden tot stille failure modes |

5) Van pilot naar autonomie: ATF als operationeel volwassenheidsmodel

Autonomie is geen feature toggle, maar een promotieproces. De Agentic Trust Framework (ATF) maakt dat concreet met niveaus:

- Intern: observe only.

- Junior: recommend, human approves.

- Senior: act, notify.

- Principal: autonome uitvoering binnen strikt domein.

De discipline zit in de promotiecriteria: tijd op niveau, performance thresholds, security validation, en expliciete sign-off. Als je die stap overslaat, wordt “autonomie” een governance-gat dat pas zichtbaar wordt na incidenten.

6) EU AI Act (NL/Benelux) vertaald naar architectuurkeuzes

Voor Nederlandse teams is de EU AI Act niet alleen een juridische tekst, maar een ontwerpconstraint. De kern is risicogebaseerd: dezelfde modelstack kan minimal risk zijn in customer support, maar high-risk worden in HR, krediet, of kritieke processen.

Concreet betekent dit in 2026 (Benelux-praktijk) dat je:

- menselijke interventiepunten in agent-loops moet kunnen afdwingen (zeker in high-risk flows);

- end-to-end audit trails nodig hebt (inputs/outputs/decision logs) en in high-risk contexten logretentie structureel moet organiseren (minstens 6 maanden);

- real-time monitoring en incident response moet hebben, niet als projectdocument maar als runbook;

- AI-geletterdheid van medewerkers moet borgen: wie beoordeelt agent-adviezen, moet ze kunnen begrijpen en overrulen;

- vendor due diligence en contractuele afspraken moet hebben over conformiteit, documentatie en verantwoordelijkheden.

Dit is precies waarom observability “control plane” wordt: compliance vraagt niet om een mooi dashboard, maar om aantoonbaar gedrag, aantoonbare grenzen en aantoonbare interventies.

7) Het onderliggende productrisico: ‘mistake code’ en quality gates

AI-assisted code generation versnelt delivery, maar produceert ook meetbaar meer onderhoudsdruk: tussen 2021 en 2024 steeg duplicatie 48% en code churn 41%, terwijl refactoring afnam. In agentic omgevingen is dit extra pijnlijk, omdat code vaak ook de tool wrappers, policy checks en integraties bevat—precies de plekken waar fouten security-impact hebben.

De remedie is niet “minder AI”, maar strengere gates:

- security scanning gericht op AI-patronen (input handling, secrets, tool access)

- duplicatie/complexity checks

- test coverage en scenario tests (agent journeys)

- behavior validation: lost dit echt het probleem op, of produceert het plausible nonsense?

Implementatie: een productiepad dat je in 2026 echt kunt verdedigen

Als je morgen start met een pilot, begin dan niet bij “autonomie”, maar bij “beheersing”. Kies één use case met duidelijke business value en gecontroleerde risico’s (bijvoorbeeld interne SOC-triage of workflow-automatisering met beperkte rechten). Bouw vervolgens:

- Een expliciet agent-pattern (ReAct/Planning/Sequential/Multi-agent) met harde tool-contracten.

- Sandboxing (MicroVM waar untrusted code mogelijk is).

- Secret injection op least-privilege basis.

- Distributed tracing + structured logs (decision rationale inbegrepen).

- Scenario-driven evals en een feedbackloop van productie-failures naar regression tests.

- ATF-leveling: start Intern/Junior, promoveer op basis van bewijs.

Wie dit pad volgt, beweegt misschien iets langzamer dan de concurrent die “alles autonoom” zet. Maar het verschil is dat jouw systeem niet alleen werkt als demo—het blijft werken wanneer het druk wordt, wanneer inputs vijandig worden, wanneer auditors vragen stellen, en wanneer 2 augustus 2026 opeens een datum met financiële betekenis wordt.

Conclusie

Production-ready AI agents bouwen in 2026 is geen modelkeuze, maar een architectuurdiscipline. De kern is coherentie: patterns die bij je risicoprofiel passen, security die tool-execution als first-class behandelt, observability die beslissingen kan reconstrueren én bijsturen, en governance die autonomie laat verdienen.

Als je één principe meeneemt: ontwerp je agent alsof je hem niet volledig vertrouwt—en geef hem pas meer macht als je het tegendeel structureel hebt bewezen.

Verder lezen (intern)

- Over veilig werken met AI-coders en tool-permissions: Veilig gebruik van AI coders: Claude, Gemini & MCP

- Voor teams die agents in marketingoperaties willen verankeren: Impact van AI op moderne marketing: statistieken 2025